Descubre Su Número De Ángel

Descargo de responsabilidad sobre IA: lo que los líderes de marketing deben saber

Tabla de contenido

El contenido generado por IA se ha vuelto omnipresente en las redes sociales en un tiempo relativamente corto, creando muchas áreas grises cuando se trata de marcas que utilizan la tecnología de IA de manera responsable.

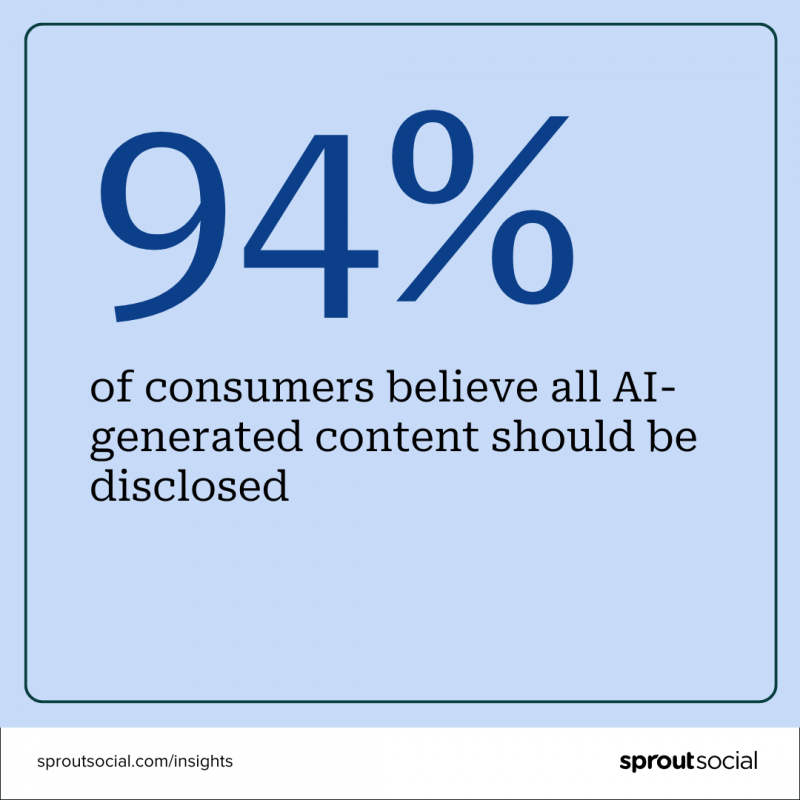

Algunas plataformas, como Meta, han propuesto exenciones de responsabilidad sobre el contenido de IA. En mayo de 2024, la empresa comenzó a etiquetar las publicaciones que detectó que eran generadas por IA con la etiqueta 'hecho con IA'. Teniendo en cuenta que una encuesta reciente de Sprout Pulse del segundo trimestre de 2024 encontró que el 94% de los consumidores cree que todo el contenido de IA debería divulgarse, este descargo de responsabilidad sobre IA parecía una solución adecuada.

Pero hubo obstáculos inesperados. Artistas y creadores afirmaron que el sello identificó erróneamente su trabajo original como generado por IA. Los especialistas en marketing que solo utilizaron herramientas de Photoshop con IA para retoques ligeros afirmaron que la etiqueta era engañosa. Meta finalmente aclaró el caso de uso de las exenciones de responsabilidad de IA y creó etiquetas más matizadas seleccionadas por los creadores.

Las preguntas clave todavía quedan en el aire. ¿Quién es responsable de hacer cumplir la uso ético de la IA ? hacer plataformas o ¿Los especialistas en marketing tienen la responsabilidad de la transparencia del consumidor?

En esta guía, analizamos el creciente debate sobre las exenciones de responsabilidad de la IA y desglosamos cómo las plataformas y marcas las abordan actualmente.

ángel número 2022

El creciente debate en torno a las exenciones de responsabilidad de la IA

Si bien casi todos los consumidores están de acuerdo en que el contenido de IA debe divulgarse, están divididos sobre quién debe hacerlo. La encuesta Sprout Pulse del segundo trimestre de 2024 encontró que el 33% cree que es responsabilidad de las marcas, mientras que el 29% cree que depende de las redes sociales. Otro 17% cree que las marcas, las redes y las plataformas de gestión de redes sociales son todas responsables.

Según la consultora de marketing digital Evangeline Sarney, esta división se debe a la relativa infancia del contenido generado por IA y la ambigüedad que lo rodea. “Primero, debemos considerar lo que definimos como contenido de IA. Si se utilizó Adobe Generative Fill para agregar gotas de agua a una imagen existente, ¿es necesaria la divulgación? Con la reacción que muchas empresas han enfrentado por las campañas generadas por IA, es fácil ver por qué dudarían en revelarlo. El contenido de IA no es la norma y no existen pautas claras. No existe un enfoque único para el etiquetado que funcione para todos los escenarios”.

Qué dicen los órganos de gobierno

El punto de Sarney se ve subrayado por el hecho de que la Comisión Federal de Comunicaciones (FCC) de EE. UU. ha distribuido requisitos de divulgación de IA para ciertos anuncios , pero aún no ha publicado directrices para el contenido generado por IA en las redes sociales. Algunos estados han introducido sus propia legislación para proteger la privacidad del consumidor en ausencia de una regulación federal.

En el extranjero, es una historia diferente. La Comisión Europea presentó formalmente el TENGO actuar en agosto de 2024, cuyo objetivo es detener la difusión de información errónea y pide a los creadores de modelos generativos de IA que presenten divulgaciones.

La ley dice: “Los implementadores de sistemas de inteligencia artificial generativa que generan o manipulan contenido de imágenes, audio o video que constituyen falsificaciones profundas deben revelar de manera visible que el contenido ha sido generado o manipulado artificialmente. Quienes implementen un sistema de inteligencia artificial que genere o manipule texto publicado con el propósito de informar al público sobre asuntos de interés público también deben revelar que el texto ha sido generado o manipulado artificialmente”.

Sin embargo, la Ley de IA estipula que no es necesario divulgar el contenido revisado por humanos y del que los humanos tienen responsabilidad editorial. La ley también categoriza el riesgo del contenido de IA y parece centrarse más en escenarios “inaceptables” y de “alto riesgo” (es decir, explotación, impacto negativo en la seguridad y privacidad de las personas, vigilancia individual).

Si bien esta ley podría ser un paso hacia estándares universales de divulgación de IA, todavía deja mucho margen de interpretación y necesita más aclaraciones, especialmente para los especialistas en marketing y las marcas.

Las preocupaciones éticas de los consumidores

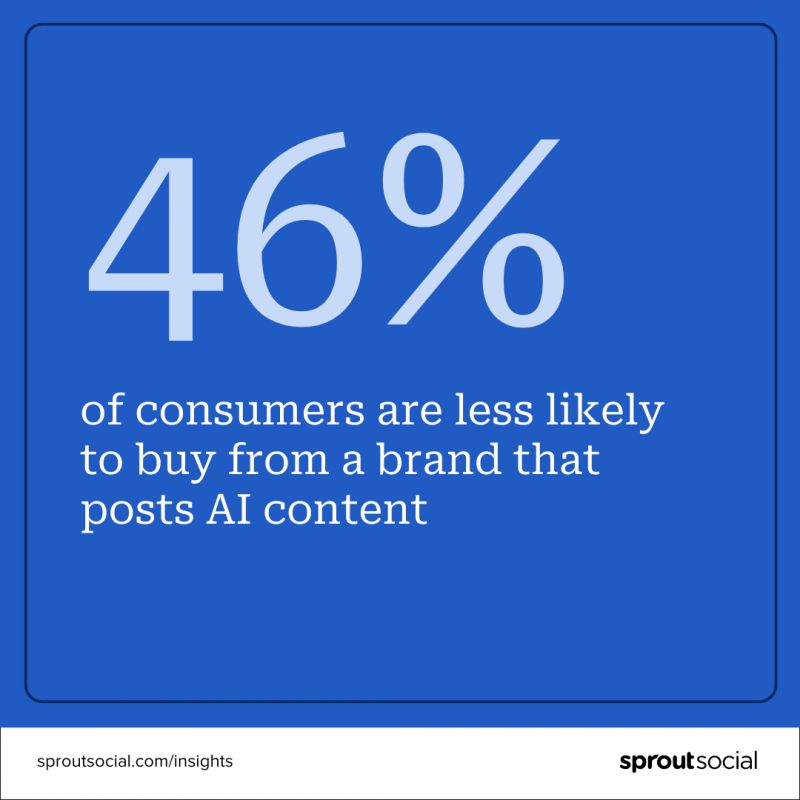

Cuando la legislación no es suficiente, las expectativas (y preocupaciones) de los consumidores pueden guiar la creación de contenido de marca. Por ejemplo, la encuesta Sprout Pulse del segundo trimestre de 2024 encontró que el 80% de los consumidores está de acuerdo en que el contenido generado por IA generará información errónea en las redes sociales, mientras que otro 46% tiene menos probabilidades de comprar de una marca que publica contenido de IA. Estas dos estadísticas podrían estar correlacionadas, según Sarney.

“Los consumidores no quieren sentir que les están mintiendo o que una marca está tratando de ocultar algo. Si una imagen se genera con IA (y claramente lo parece) pero no se divulga, un consumidor puede cuestionarla. para mantener confianza y autenticidad, las marcas deben crear marcos para lo que debe divulgarse y cuándo”.

También insta a los especialistas en marketing a pensar críticamente por qué están usando IA. ¿Es para promover su capacidades creativas y acelerar procesos manuales ?

Sarney recordó un incidente reciente en el que una revista de estilo de vida que anteriormente había sido criticada por su falta de diversidad creó un miembro del personal BIPOC generado por IA. “Su cuenta de Instagram se vio inundada de comentarios negativos que cuestionaban por qué la empresa no podía simplemente contratar a un POC real. Los comentaristas denunciaron la disminución del número de puestos de trabajo para la comunidad BIPOC dentro de la industria de la moda y muchos se preguntaron por qué, en lugar de crear un editor de moda falso, la empresa no contrató simplemente a uno”.

Hay muchos casos de uso que encajan bajo el paraguas del contenido generado por IA, y lo que tiene sentido divulgar variará dependiendo de su marca, industria y riesgo para el público. Pero, en general, las marcas deben evitar crear seres humanos generados por IA (especialmente para representar a los niños, la comunidad BIPOC y las personas discapacitadas) sin revelar específicamente que lo han hecho y su propósito. Casi siempre deberían evitar crear contenido de IA sobre eventos actuales o que esté fuertemente inspirado en la propiedad intelectual de otros. Estas áreas son donde la IA presenta los mayores riesgos para la salud de la marca y, lo que es más importante, para la seguridad pública.

Cómo manejan las diferentes redes las exenciones de responsabilidad de la IA

En medio del creciente debate sobre las exenciones de responsabilidad de la IA y el aumento generalizado del contenido generado por la IA, las redes sociales están tomando medidas para sofocar la difusión de información errónea y mantener la confianza en sus plataformas. Principalmente, facilitando a los creadores etiquetar claramente su contenido como modificado por IA. Estas son las formas en que cada red aborda actualmente las exenciones de responsabilidad sobre la IA y lo que eso significa para las marcas.

significado del número 41

Meta

Como se mencionó, Meta cambió su etiqueta de descargo de responsabilidad sobre IA en julio de 2024 para alinearse mejor con las expectativas de los consumidores y las marcas por igual. Describen su nueva etiqueta “AI info” en su publicación de blog : 'Si bien trabajamos con empresas de toda la industria para mejorar el proceso para que nuestro enfoque de etiquetado coincida mejor con nuestra intención, estamos actualizando la etiqueta 'Hecho con IA' a 'Información de IA' en todas nuestras aplicaciones, en la que las personas pueden hacer clic para obtener más información. .”

La compañía ha comenzado a agregar estas etiquetas al contenido cuando detectan indicadores de imágenes de IA estándar de la industria o cuando las personas revelan que están cargando contenido generado por IA. Cuando los usuarios hacen clic en la etiqueta, pueden ver cómo se podría haber utilizado la IA para crear la imagen o el vídeo.

YouTube

YouTube dio a conocer un herramienta en su Creator Studio para facilitar a los creadores la autoseleccionación cuando su video ha sido alterado significativamente con IA generativa, o es sintético y parece real. Los creadores deben revelar contenido generado por IA cuando sea tan realista que una persona podría confundirlo fácilmente con una persona, lugar o evento real, según las Normas de la comunidad de YouTube.

Como describe YouTube, 'las etiquetas aparecerán dentro de la descripción del video, y si el contenido está relacionado con temas delicados como salud, noticias, elecciones o finanzas, también mostraremos una etiqueta en el video en la ventana del reproductor'.

Si bien YouTube exige que los creadores revelen por sí mismos cuando han utilizado contenido alterado o sintético en sus videos, también pueden aplicar la etiqueta en los casos en que esta divulgación no haya ocurrido, especialmente cuando el contenido trata los temas delicados mencionados anteriormente.

tiktok

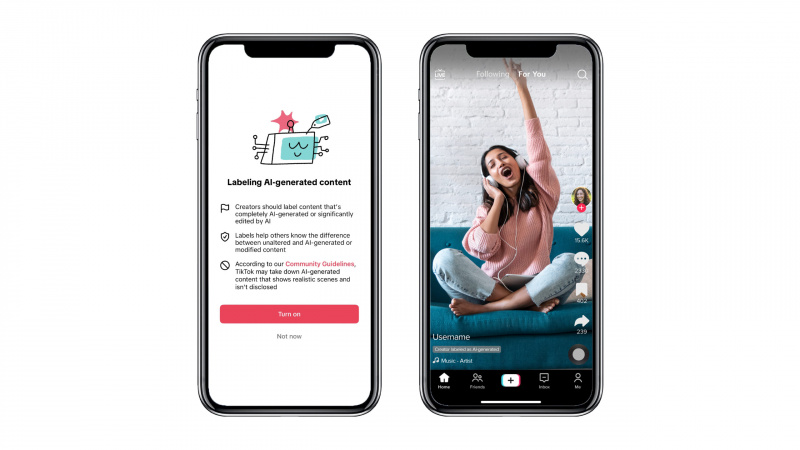

Tik Tok etiqueta de creador para contenido de IA permite a los usuarios revelar cuándo las publicaciones están completamente generadas por IA o editadas significativamente por IA. La etiqueta facilita a los creadores el cumplimiento de la política de medios sintéticos de las Directrices comunitarias de TikTok, que introdujeron en 2023.

El política requiere que las personas etiqueten publicaciones generadas por IA que contengan imágenes, audio o video realistas, para ayudar a los espectadores a contextualizar el video y evitar la posible difusión de contenido engañoso.

significado de 999

Si los creadores no divulgan el contenido generado por IA, TikTok puede aplicar automáticamente una etiqueta 'generado por IA' al contenido que la plataforma sospecha que fue editado o creado con IA.

En mayo de 2024, LinkedIn se asoció con Coalición para la procedencia y autenticidad del contenido (C2PA) desarrollar estándares técnicos para aclarar los orígenes del contenido digital, incluido el contenido generado por IA. En lugar de etiquetar estrictamente el contenido como generado por IA, como lo han hecho la mayoría de las plataformas, el enfoque de LinkedIn vería todo el contenido etiquetado.

La plataforma explica: “El contenido de imágenes y videos firmado criptográficamente mediante credenciales de contenido C2PA se indicará con el ícono C2PA. Al hacer clic en esta etiqueta, se mostrarán la credencial del contenido y los metadatos disponibles, como la fuente del contenido (por ejemplo, el modelo de cámara indicado o la herramienta de inteligencia artificial que se utilizó para generar toda o parte de la imagen) y la información emitida por, hacia y sobre. '

Pero cabe señalar que esta verificación sólo funciona si su contenido ya contiene credenciales C2PA. De lo contrario, es mejor revelar el contenido generado por IA en el título, si eso se alinea con las pautas de su marca.

Ejemplos de descargo de responsabilidad de IA de 3 marcas

Dado que la mayoría de las plataformas comienzan a ofrecer etiquetas de exención de responsabilidad de IA, no es tan importante cómo usted divulga contenido generado por IA (es decir, usando sus etiquetas), simplemente eso es lo que hace. Ya sea en el título o en una marca de agua en una imagen o vídeo. No solo para cumplir con las pautas de la comunidad (y evitar que su contenido sea marcado o eliminado), sino también para mantener la confianza con sus seguidores.

Aquí hay tres marcas quiénes crean contenido generado por IA y cómo optan por divulgarlo.

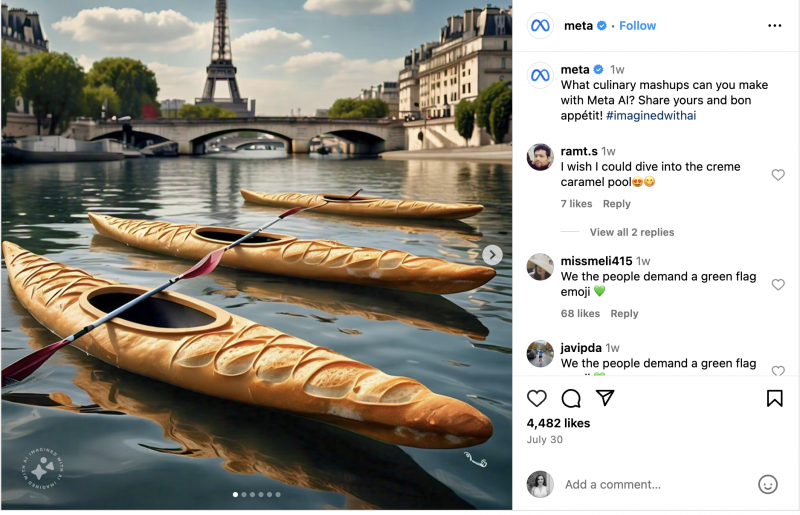

Meta

En Instagram, la plataforma identifica sus imágenes y videos generados por IA al incluir el hashtag #ImaginedwithAI en sus títulos y una marca de agua 'Imagined with AI' en la esquina inferior izquierda de sus fotos.

La compañía también cuenta una historia sobre el uso de IA en sus subtítulos y alienta a sus seguidores a probar indicaciones específicas en su plataforma Meta AI (como 'combinaciones culinarias', que se muestran en esta publicación).

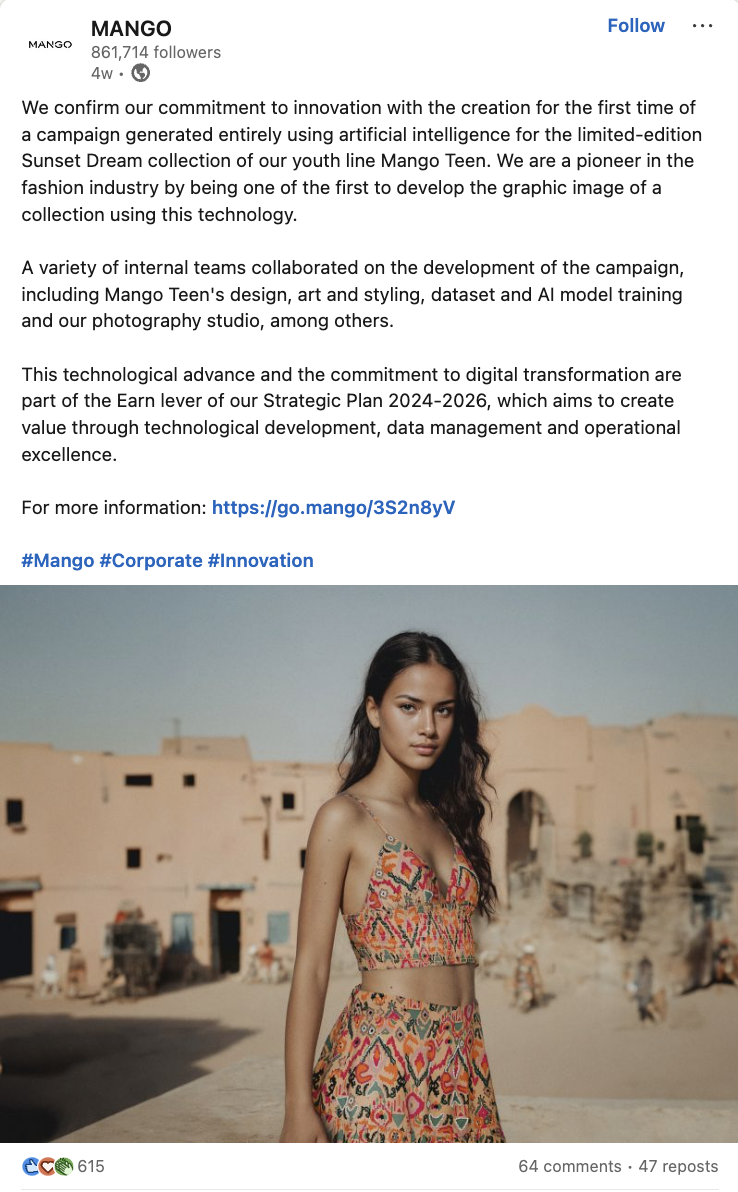

MANGO

El minorista de moda español MANGO presentó su primera campaña completamente generada por IA en LinkedIn. Su declaración se centró menos en la divulgación y en cambio enfatizó los avances tecnológicos que hicieron posible la campaña. En el título de su publicación, la marca explicó por qué decidieron crear una campaña completamente generada por IA y cómo afecta su estrategia de negocio .

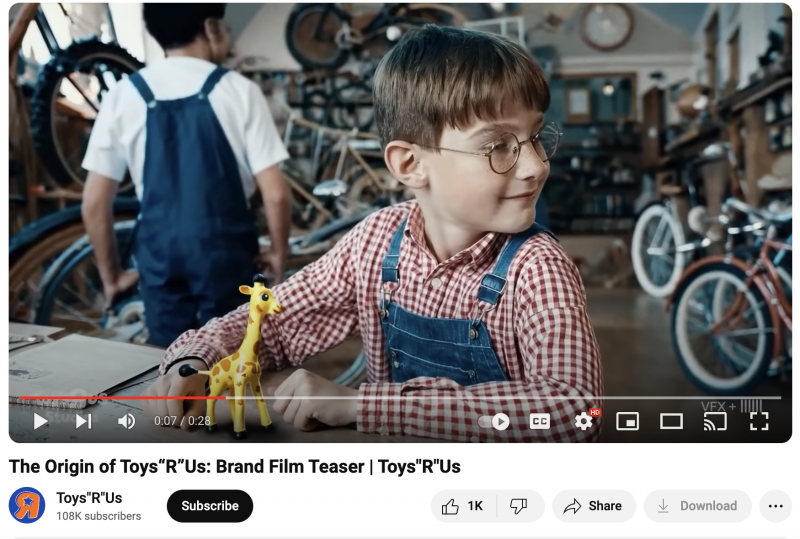

Juguetes “R” Us

La juguetería Toys“R”Us presentó recientemente un vídeo de un minuto sobre la historia del origen de su empresa, creado íntegramente por IA. La marca afirma que el video es la primera película de la marca creada con la tecnología OpenAI Sora, como explicaron en su título de YouTube y presione soltar .

Desde el lanzamiento de la película en el Festival de Cine de Venecia, Toys “R” Us ha promovido sus orígenes en IA, demostrando que las revelaciones pueden ser oportunidades potentes para generar expectación sobre la marca. Incluso si el contenido generado por IA despierta sentimientos negativos, Toys “R” Us es una prueba de que (a veces) toda prensa es buena prensa .

Divulgue a discreción de su audiencia

A medida que el contenido generado por IA se vuelve más frecuente en las redes sociales, las marcas deben encontrar el equilibrio entre innovación y transparencia. Eso incluye la creación de pautas de marca que definan cuándo son necesarias las exenciones de responsabilidad de la IA. Si bien las plataformas están implementando políticas individuales y algunas agencias gubernamentales están interviniendo, la mayor parte de la responsabilidad aún recae en las marcas.

Al decidir cuándo es apropiado que su marca haga divulgaciones sobre IA, piense en su audiencia. Las divulgaciones son esenciales para mantener la credibilidad cuando la IA manipula significativamente la realidad o involucra temas delicados. Sin embargo, es posible que las mejoras menores no requieran un etiquetado explícito.

606 números de ángel

Al comprender estos matices, podrá utilizar la IA de manera responsable y de una manera que fomente el ancho de banda y la creatividad de su equipo (en lugar de crear una crisis de marca).

¿Busca más formas de incorporar éticamente la IA en los flujos de trabajo de su equipo? Lee como Los CMO están utilizando la IA en sus estrategias de marketing.

Compartir Con Tus Amigos: